본문

제품 정보

LIME & SHAP

| Date | 2022-11-17 |

|---|---|

| Speaker | 김현호 |

- 이전글NET-DNF 22.11.18

- 다음글Incorporating Prior Domain Knowledge into Loss Function 22.11.03

Topic:

LIME & SHAP

Keywords:

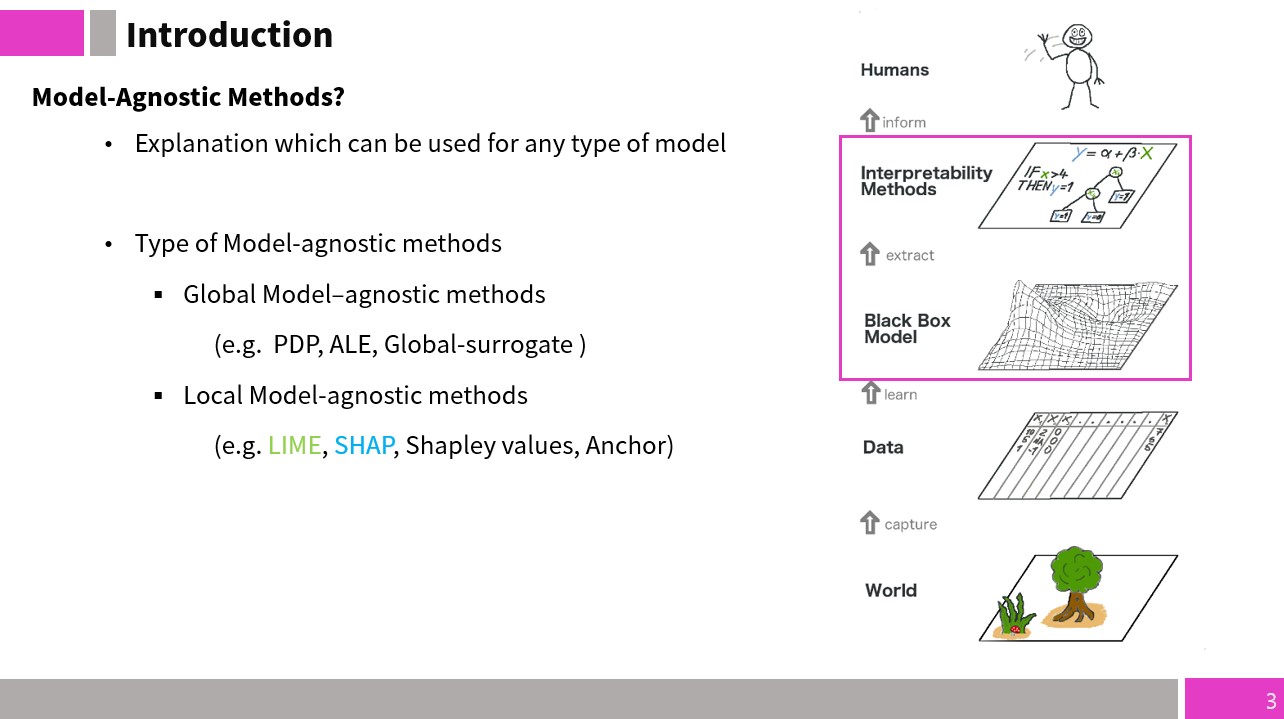

Explanable AI

Model-agnostic local surrogate model

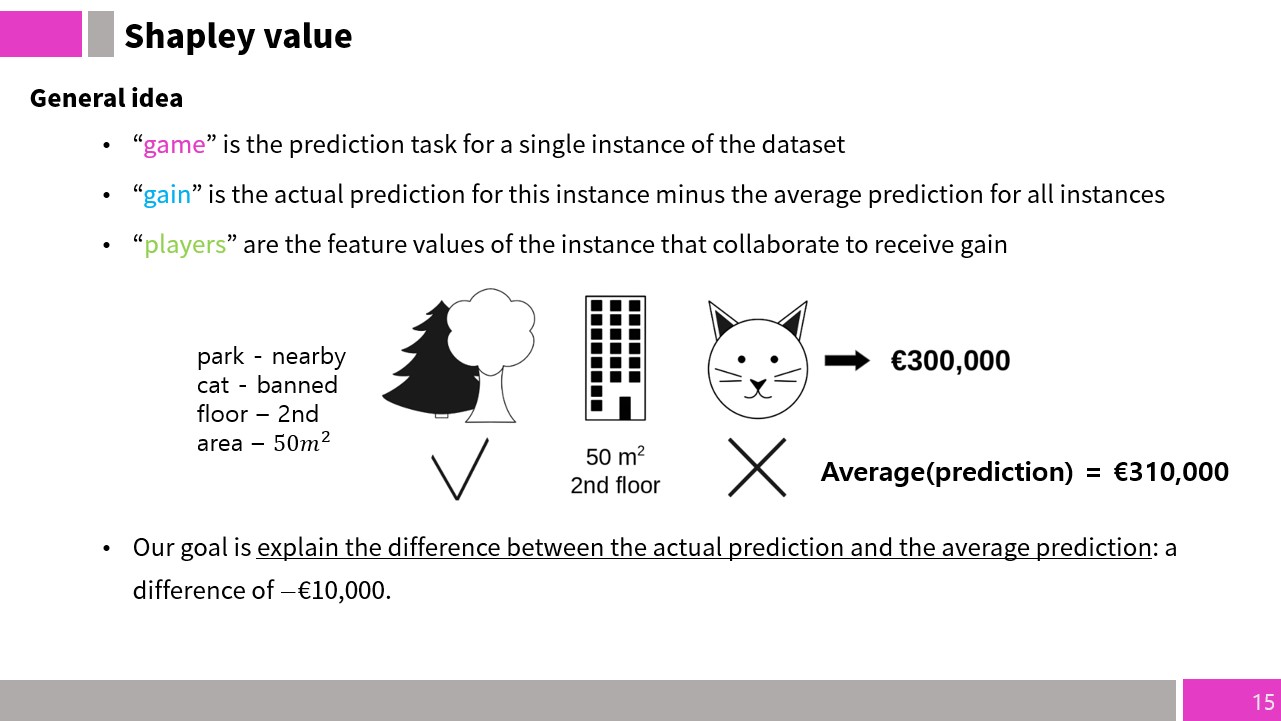

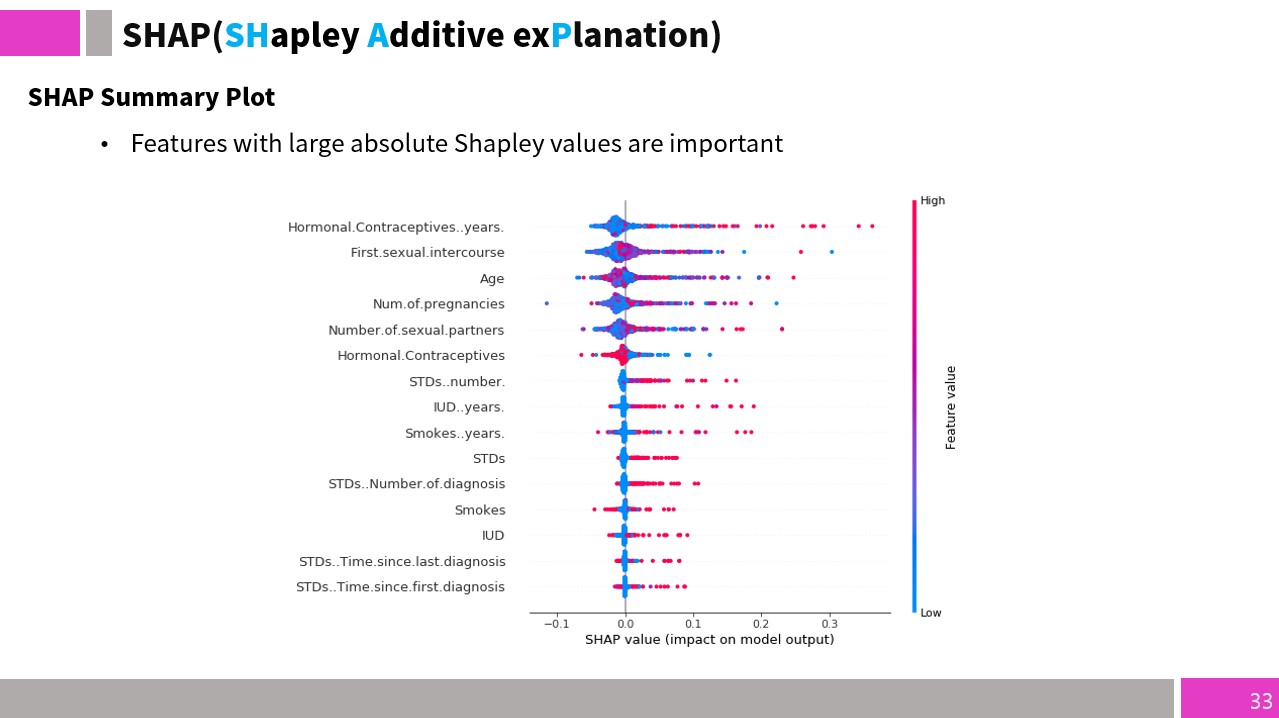

Shapley value,

LIME,

Reference:

1. Ribeiro, Marco Tulio, Sameer Singh, and Carlos Guestrin. "" Why should i trust you?" Explaining the predictions of any classifier." Proceedings of the 22nd ACM SIGKDD international conference on knowledge discovery and data mining. 2016.

2. Lundberg, Scott M., and Su-In Lee. "A unified approach to interpreting model predictions." Advances in neural information processing systems 30 (2017).

첨부파일

-

LIMESHAP.pdf (2.5M)

41회 다운로드 | DATE : 2022-11-17 19:08:47

관련링크

저작자표시-비영리-동일조건변경허락(BY-NC-SA)

저작자와 출처 등을 표시하면 저작물의 변경, 2차적 저작물의 작성을 포함한 자유이용을 허락합니다.

단 영리적 이용은 허용되지 않고 2차적 저작물에는 원저작물에 적용된 라이선스와 동일한 라이선스를 적용해야 합니다.